L’esercito israeliano ha contrassegnato decine di migliaia di gazawi come sospetti per l’assassinio, utilizzando un sistema di puntamento AI con scarsa supervisione umana e una politica permissiva per i danni collaterali, rivelano +972 e Local Call.

Fonte: English version

Yuval Abraham – 3 Aprile 2024

Immagine di copertina: fumo dopo il bombardamento di Beit Lahia, nel nord della Striscia, il 28 dicembre 2023 (Yonathan Sindel/Flash90)

Nel 2021, un libro intitolato “La squadra della Macchina-Umana: come creare sinergia fra intelligenza umana e l’intelligenza artificiale che rivoluzionerà il nostro mondo” è stato pubblicato in inglese con lo pseudonimo di “Brigadier General Y.S.” Nel libro, l’autore- un uomo che confermiamo essere l’attuale comandante dell’unità di élite dell’intelligence israeliana 8200- propone di progettare una macchina speciale in grado di elaborare rapidamente enormi quantità di dati per generare migliaia di potenziali “bersagli” per gli attacchi militari nel pieno di una guerra. Una simile tecnologia, scrive, risolverebbe ciò che descrive come un “collo di bottiglia” umano sia per la localizzazione dei nuovi obiettivi che per il processo decisionale di approvazione degli obiettivi”.

Pare che, questa macchina, esista davvero. Una nuova inchiesta di +972 Magazine e Local Call, rivela che l’esercito israeliano ha sviluppato un programma basato sull’intelligenza artificiale, conosciuto come “Lavender”, svelato qui per la prima volta. Secondo sei ufficiali dell’intelligence israeliana, che sono stati nell’esercito durante l’attuale guerra nella Striscia di Gaza e sono stati coinvolti per la prima volta, nell’uso dell’IA per generare obiettivi degli attacchi, Lavender ha giocato un ruolo centrale nel bombardamento senza precedenti dei Palestinesi, soprattutto durante le prime fasi della guerra. Infatti, secondo le fonti, l’influenza di questa tecnologia sulle operazioni militare, è stata tale che i risultati della macchina basata su IA, sono stati considerati “come se fossero decisioni umane”.

Formalmente, il sistema Lavender, è progettato per segnalare tutti i sospetti operativi nelle ali militari di Hamas e nella Jihad Islamica Palestinese (PIJ), compresi quelli di basso rango come potenziali obiettivi degli attacchi. La fonte ha dichiarato a +972 e Local Call che, durante le prime settimane di guerra, l’esercito si è affidato quasi completamente a Lavender, che ha censito ben 37.000 palestinesi come sospetti militanti – e le loro case come obiettivo – per possibili attacchi aerei.

Durante le prime fasi della guerra, l’esercito ha approvato in modo generalizzato l’adozione da parte degli ufficiali delle liste di uccisioni di Lavender, senza alcun obbligo di verificare a fondo il motivo per cui la macchina aveva fatto quelle scelte o di esaminare i dati di intelligence grezzi su cui si basavano. Una fonte ha affermato che il personale umano spesso serviva come “timbro di gomma” per le decisioni della macchina, aggiungendo che, normalmente, dedicavano circa “20 secondi “ad ogni obiettivo prima di autorizzare un bombardamento-tanto per essere sicuri che l’obiettivo selezionato da Lavander fosse maschio. Questo, nonostante sapessero che il sistema commette ciò che viene considerato “errore” in circa il 10 percento dei casi, ed è noto per contrassegnare occasionalmente individui che hanno solo un legame debole o nessun legame, con gruppi militanti.

Inoltre, l’esercito israeliano ha sistematicamente attaccato i bersagli selezionati mentre erano nelle loro case-di solito di notte, quando le loro intere famiglie erano presenti- e non durante il corso di attività militari. Secondo le fonti, dal punto di vista dell’intelligence, era più facile la localizzazione degli individui, quando questi erano nelle loro abitazioni private. Altri sistemi automatizzati, tra cui uno chiamato “Where is Daddy? Dov’è papà?”, anch’esso rivelato qui per la prima volta, sono stati utilizzati specificamente per rintracciare gli individui presi di mira e compiere attentati quando erano entrati nelle residenze delle loro famiglie.

Il risultato, come testimoniato dalle fonti, è che migliaia di Palestinesi-molti dei quali donne, bambini o persone non coinvolte nei combattimenti- sono stati spazzati via dagli attacchi aerei israeliani, soprattutto nelle prime settimane di guerra, a causa delle decisioni del programma AI.

“Non ci interessava uccidere gli operativi [di Hamas] solo quando si trovavano in un edificio militare o erano impegnati in un’attività militare”, ha dichiarato A, un ufficiale dei servizi segreti a +972 e Local Call. “Al contrario, l’IDF li bombardava nelle loro case senza esitazioni, come prima opzione. E’ più facile bombardare una residenza familiare. Il sistema è realizzato proprio per trovarli in circostanze del genere.

La macchina Lavender si aggiunge a un altro sistema di intelligenza artificiale, “The Gospel”(Il Vangelo), le cui informazioni sono state rivelate in una precedente indagine di +972 e Local Call nel novembre 2023, oltre che nelle pubblicazioni dell’esercito israeliano. Una differenza fondamentale tra i due sistemi sta nella definizione del bersaglio: mentre The Gospel contrassegna gli edifici e le strutture da cui l’esercito sostiene che operano i militanti, Lavender contrassegna le persone – e le inserisce in una lista di uccisioni.

Inoltre, secondo le fonti, quando si trattava di colpire i presunti militanti junior segnalati da Lavender, l’esercito preferiva usare solo missili non guidati, comunemente noti come bombe “mute” (in contrasto con le bombe di precisione “intelligenti”), che possono distruggere interi edifici sopra i loro occupanti e causare vittime significative. “Non si vogliono sprecare bombe costose per persone non importanti – è molto costoso per il Paese e c’è una carenza [di queste bombe]”, ha detto C., uno degli ufficiali dell’intelligence. Un’altra fonte ha detto di aver autorizzato personalmente il bombardamento di “centinaia” di case private di presunti agenti minori segnalati da Lavender, con molti di questi attacchi che hanno ucciso civili e intere famiglie come “danni collaterali”.

In una mossa senza precedenti, secondo due delle fonti, l’esercito ha anche deciso durante le prime settimane di guerra che, per ogni agente di Hamas di basso livello che Lavender ha marcato, era lecito uccidere fino a 15 o 20 civili; in passato, l’esercito non autorizzava alcun “danno collaterale” durante l’assassinio di militanti di basso rango. Le fonti hanno aggiunto che, nel caso in cui l’obiettivo fosse un alto funzionario di Hamas con il grado di comandante di battaglione o di brigata, l’esercito ha autorizzato in diverse occasioni l’uccisione di più di 100 civili nell’assassinio di un singolo comandante.

La seguente indagine è organizzata secondo le sei fasi cronologiche della produzione di bersagli altamente automatizzati da parte dell’esercito israeliano nelle prime settimane della guerra di Gaza. In primo luogo, spieghiamo la macchina Lavender stessa, che ha selezionato decine di migliaia di palestinesi utilizzando l’intelligenza artificiale. In secondo luogo, riveliamo il sistema “Where is Daddy?”, che tracciava questi obiettivi e segnalava all’esercito quando entravano nelle case delle famiglie. In terzo luogo, descriviamo come sono state scelte le bombe “mute” per colpire queste case.

In quarto luogo, spieghiamo come l’esercito abbia allentato il numero di civili che potevano essere uccisi durante il bombardamento di un obiettivo. In quinto luogo, notiamo come un software automatico abbia calcolato in modo impreciso la quantità di non combattenti in ogni famiglia. In sesto luogo, mostriamo come in diverse occasioni, quando una casa veniva colpita, di solito di notte, l’obiettivo individuale a volte non era affatto all’interno, perché gli ufficiali militari non verificavano le informazioni in tempo reale.

STEP: DEFINIZIONE DEGLI OBIETTIVI

Una volta che si passa all’automatismo, la generazione di bersagli impazzisce”.

Nell’esercito israeliano, il termine “bersaglio umano” si riferiva in passato a un agente militare di alto livello che, secondo le regole del Dipartimento di diritto internazionale dell’esercito, può essere ucciso nella sua casa privata anche se ci sono civili nei dintorni. Fonti dell’intelligence hanno riferito a +972 e a Local Call che durante le precedenti guerre israeliane, poiché si trattava di un modo “particolarmente brutale” di uccidere qualcuno – spesso uccidendo un’intera famiglia accanto al bersaglio – questi obiettivi umani erano selezionati con molta attenzione e solo i comandanti militari di alto livello venivano bombardati nelle loro case, per mantenere il principio di proporzionalità previsto dal diritto internazionale.

Ma dopo il 7 ottobre – quando i militanti guidati da Hamas hanno lanciato un assalto mortale contro le comunità israeliane meridionali, uccidendo circa 1.200 persone e sequestrandone 240 – l’esercito, secondo le fonti, ha adottato un approccio radicalmente diverso. Nell’ambito dell’operazione “Spade di ferro”, l’esercito ha deciso di designare tutti gli operatori dell’ala militare di Hamas come obiettivi umani, indipendentemente dal loro grado o dalla loro importanza militare. E questo ha cambiato tutto.

La nuova politica pone anche un problema tecnico per l’intelligence israeliana. Nelle guerre precedenti, al fine di autorizzare l’uccisione di un singolo bersaglio umano, un ufficiale doveva passare attraverso un complesso e lungo processo di “incriminazione”: prove incrociate che la persona fosse un membro senior dell’ala militare di Hamas, rintracciamento di dove abitasse, i suoi contatti operativi, le informazioni di contatto e infine quando fosse in casa. Quando l’elenco dei bersagli era composto solo da poche decine di alti funzionari, il personale dell’intelligence poteva gestire individualmente il lavoro necessario per incriminarli e localizzarli.

Tuttavia, una volta che l’elenco è stato ampliato per includere decine di migliaia di agenti di grado inferiore, l’esercito israeliano ha pensato di doversi affidare a software automatizzati e all’intelligenza artificiale. Il risultato, testimoniano le fonti, è stato che il ruolo del personale umano nell’incriminare i palestinesi come agenti militari è stato messo da parte e l’intelligenza artificiale ha svolto la maggior parte del lavoro. Secondo quattro delle fonti che hanno parlato con +972 e Local Call, Lavender – che è stato sviluppato per creare obiettivi umani nella guerra in corso – ha contrassegnato circa 37.000 palestinesi come sospetti “militanti di Hamas”, la maggior parte dei quali giovani, da assassinare (il portavoce dell’IDF ha negato l’esistenza di tale lista di uccisioni in una dichiarazione a +972 e Local Call).

Non sapevamo chi fossero gli operatori junior, perché Israele non li tracciava abitualmente [prima della guerra]”, ha spiegato l’ufficiale superiore B. a +972 e Local Call, spiegando la ragione dietro lo sviluppo di questa particolare macchina bersaglio per la guerra in corso. “Volevano permetterci di attaccare [gli agenti minori] automaticamente. Questo è il Sacro Graal. Una volta che si passa all’automatismo, la generazione dei bersagli impazzisce”.

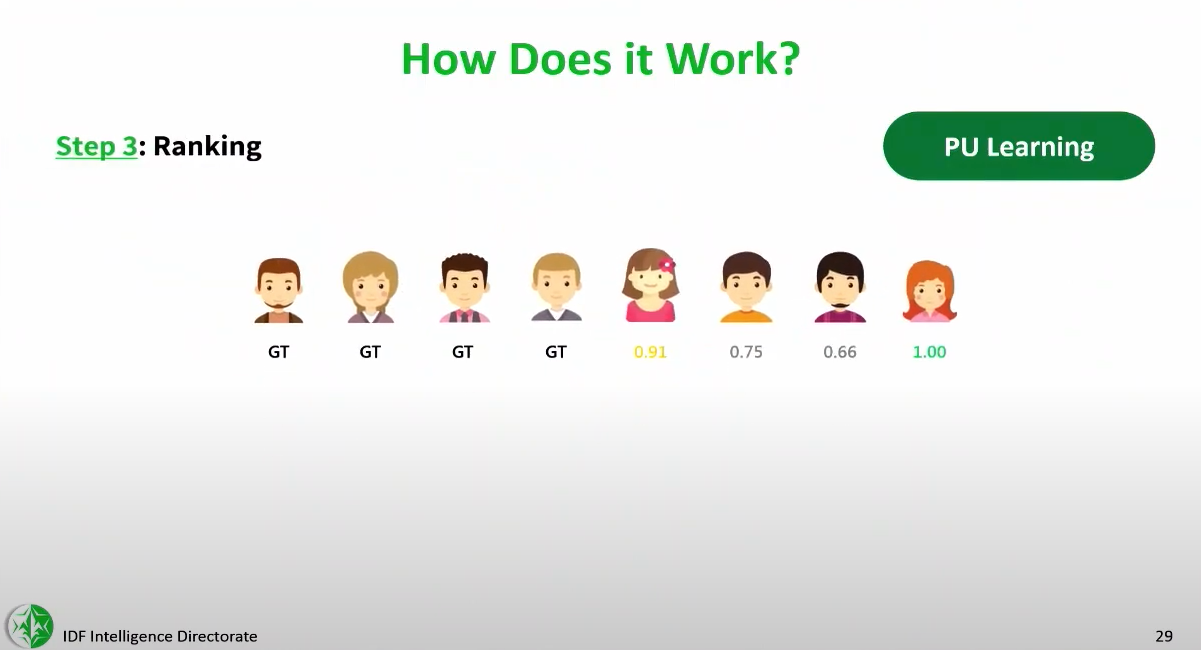

Le fonti hanno detto che l’approvazione ad adottare automaticamente gli elenchi di uccisioni di Lavender, che in precedenza era stato usato solo come strumento ausiliario, è stata concessa circa due settimane dopo l’inizio della guerra, dopo che il personale dell’intelligence ha controllato “manualmente” l’accuratezza di un campione casuale di diverse centinaia di obiettivi selezionati dal sistema di intelligenza artificiale. Quando tale campione ha rilevato che i risultati di Lavender avevano raggiunto un’accuratezza del 90% nell’identificare l’affiliazione di un individuo ad Hamas, l’esercito ha autorizzato l’uso generalizzato del sistema. Da quel momento, le fonti hanno detto che se Lavender decideva che un individuo era un militante di Hamas, veniva chiesto loro di trattarlo essenzialmente come un ordine, senza alcun obbligo di verificare in modo indipendente perché la macchina avesse fatto quella scelta o di esaminare i dati di intelligence grezzi su cui si basa.

“Alle cinque del mattino, le forze aeree arrivavano e bombardavano tutte le case che avevamo indicato” ha detto B. “Abbiamo eliminato migliaia di persone. Non li abbiamo analizzati uno per uno- li abbiamo inseriti nel sistema e appena l’individuo selezionato era in casa, diventava immediatamente un bersaglio. Bombardavamo lui e la sua casa.”

“E’ stato sorprendente per me ricevere l’ordine di bombardare una casa per uccidere un soldato di terra, la cui importanza nei combattimenti era così irrisoria”, ha detto una fonte riguardo l’uso dell’Intelligenza Artificiale per marcare presunti militanti di basso rango. Ho soprannominato questi obiettivi “obiettivi spazzatura”. Tuttavia, li trovavo più etici degli obiettivi che bombardavamo solo per “deterrenza”: grattacieli che venivano evacuati e colpiti solo per causare distruzione”

I risultati devastanti di questo allentamento delle restrizioni nella prima fase della guerra sono stati shoccanti. Secondo i dati del ministero della Salute palestinese a Gaza, sul quale l’ esercito israeliano ha fatto affidamento quasi esclusivamente dall’inizio della guerra, Israele ha ucciso circa 15.000 palestinesi – quasi la metà del bilancio delle vittime finora – nelle prime sei settimane di guerra, fino a quando è stato concordato un cessate il fuoco di una settimana il 24 novembre.

“Quante più informazioni e varietà ci sono, meglio è”

Il software di Lavender analizza le informazioni raccolte sulla maggior parte dei 2.3 milioni di residenti della Striscia di Gaza, attraverso un sistema di sorveglianza di massa, poi valuta e classifica la possibilità che ogni singola persona sia attiva nell’ala militare di Hamas o nel PIJ. Secondo le fonti, la macchina dà ad ogni singolo abitante di Gaza un punteggio da 1 a 100, per esprimere la possibilità che questi sia un militante. Lavender impara a identificare le caratteristiche degli operativi noti di Hamas e PIJ, le cui informazioni sono state fornite alla macchina come dati di addestramento, e poi a identificare queste stesse caratteristiche tra la popolazione generale, hanno spiegato le fonti. Un individuo con diverse caratteristiche incriminanti otterrà un punteggio elevato, diventando così automaticamente un potenziale bersaglio per l’uccisione.Nel libro citato all’inizio di questo articolo “The Human -Machine Team”, l’attuale comandante dell’Unità 8200, sostiene questo tipo di sistema senza fare esplicitamente il nome di Lavender. (Il comandante non è nominato, ma cinque fonti nella 8200 hanno confermato che il comandante è l’autore come riportato anche da Haaretz). Descrivendo il personale umano come “collo di bottiglia” che limita la capacità dell’esercito durante un’operazione militare, il comandante si lamenta:” Noi umani non possiamo processare tante informazioni. Non importa a quante persone tu abbia dato il compito di produrre bersagli durante la guerra- comunque non puoi produrre abbastanza obiettivi al giorno.”

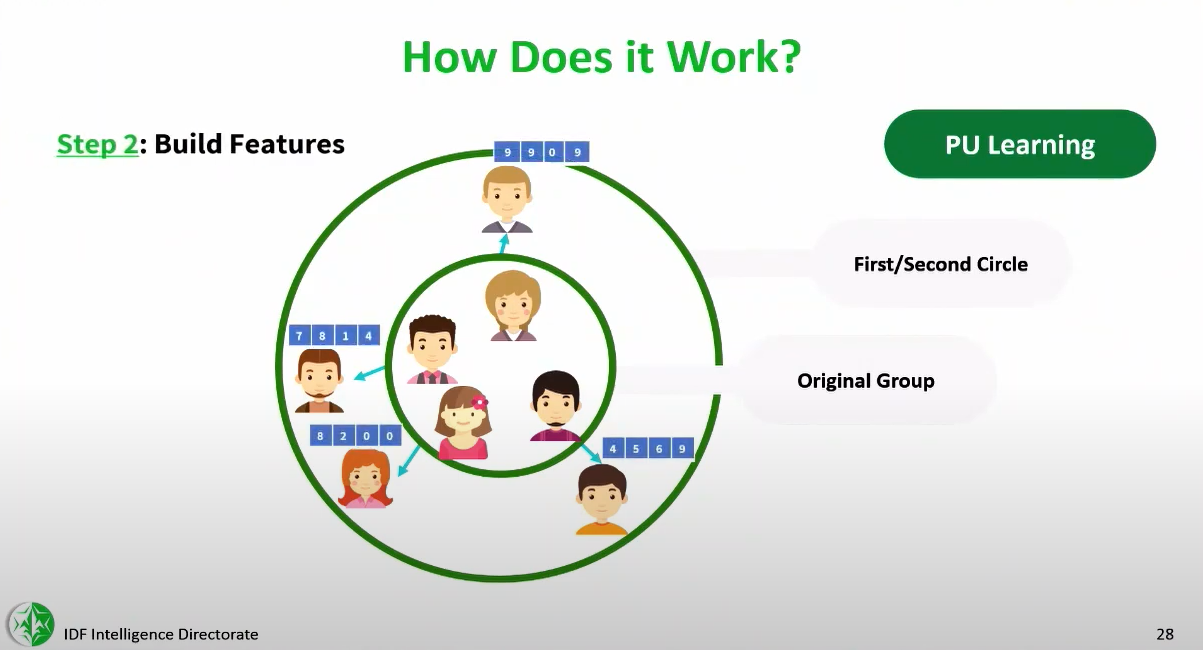

La soluzione a questo problema, secondo l’autore, è l’intelligenza artificiale. Il libro offre una breve guida alla costruzione di una “macchina target”, simile nella descrizione a Lavender, basata su algoritmi di intelligenza artificiale e apprendimento automatico. La guida contiene diversi esempi delle “centinaia e migliaia” di caratteristiche che possono aumentare il rating di un individuo, come l’appartenenza a un gruppo Whatsapp con un noto militante, il cambio di cellulare ogni pochi mesi e il frequente cambio di indirizzo.

“Più informazioni abbiamo, più varietà di informazioni abbiamo, meglio è” scrive il comandante. “Informazioni visive, cellulare, connessioni sui social media, informazioni sul campo di battaglia, contatti telefonici, foto”. Mentre gli umani selezionano prima queste caratteristiche, continua il comandante, con il tempo, la macchina riuscirà da sola a identificarle. Questo, afferma, può permettere ai militari di creare “decine di migliaia di bersagli”, mentre ora la decisione su attaccare o meno rimane una decisione umana.

Il libro non è l’unica volta in cui un alto comandante israeliano ha accennato all’esistenza di macchine con obiettivi umani come Lavender. +972 e Local Call hanno ottenuto il filmato di una conferenza privata tenuta dal comandante del centro segreto di scienza dei dati e intelligenza artificiale dell’Unità 8200, “Col. Yoav”, alla settimana dell’intelligenza artificiale dell’Università di Tel Aviv nel 2023, di cui hanno parlato all’epoca i media israeliani.Nella conferenza, il comandante parla di una nuova e sofisticata macchina bersaglio utilizzata dall’esercito israeliano che individua “persone pericolose” in base alla loro somiglianza con le liste esistenti di militanti noti su cui è stata addestrata. “Usando il sistema, siamo riusciti a identificare i comandanti delle squadre missilistiche di Hamas”, ha detto il “Col. Yoav” nella conferenza, riferendosi all’operazione militare israeliana del maggio 2021 a Gaza, quando la macchina è stata usata per la prima volta.

Le diapositive di presentazione della conferenza, ottenute anche da +972 e Local Call, contengono illustrazioni di come funziona la macchina: le vengono forniti dati su operatori di Hamas esistenti, impara a notare le loro caratteristiche e poi valuta altri palestinesi in base a quanto sono simili ai militanti.”Classifichiamo i risultati e determiniamo la soglia [in cui attaccare un obiettivo]”, ha detto il “Col. Yoav” nella conferenza, sottolineando che “alla fine le decisioni vengono prese da persone in carne e ossa”. Nel settore della difesa, dal punto di vista etico, poniamo molta enfasi su questo aspetto. Questi strumenti sono pensati per aiutare [gli agenti dell’intelligence] a rompere le loro barriere”. In pratica, tuttavia, le fonti che hanno utilizzato Lavender negli ultimi mesi dicono che l’agenzia umana e la precisione sono state sostituite dalla creazione di bersagli di massa e dalla letalità.

“Non c’era una politica “zero errori”.

B., un ufficiale superiore che ha utilizzato Lavender, ha dichiarato a +972 e a Local Call che nella guerra in corso gli ufficiali non sono tenuti a rivedere in modo indipendente le valutazioni del sistema IA, per risparmiare tempo e consentire la produzione di massa di obiettivi umani senza ostacoli.

“Tutto era statistico, tutto era ordinato – era molto asciutto”, ha detto B.. Ha notato che questa mancanza di supervisione è stata permessa nonostante i controlli interni mostrassero che i calcoli di Lavender erano considerati accurati solo il 90% delle volte; in altre parole, si sapeva in anticipo che il 10% degli obiettivi umani destinati all’assassinio non erano affatto membri dell’ala militare di Hamas.

Ad esempio, le fonti hanno spiegato che la macchina Lavender a volte ha erroneamente segnalato individui che avevano modelli di comunicazione simili a noti operatori di Hamas o PIJ – tra cui operatori di polizia e della protezione civile, parenti di militanti, residenti che avevano un nome e un soprannome identici a quelli di un operatore e gazawi che usavano un dispositivo appartenuto a un operatore di Hamas.

“Quanto deve essere vicina una persona ad Hamas per essere [considerata da una macchina AI come] affiliata all’organizzazione?”, ha detto una fonte critica dell’imprecisione di Lavender. “È un confine vago. Una persona che non riceve uno stipendio da Hamas, ma che la aiuta in ogni genere di cose, è un agente di Hamas? Una persona che ha fatto parte di Hamas in passato, ma che oggi non ne fa più parte, è un operativo di Hamas? Ognuna di queste caratteristiche – caratteristiche che una macchina segnalerebbe come sospette – è imprecisa”.

Problemi simili si presentano con la capacità della macchina di individuare il telefono usato da un individuo segnalato per essere ucciso. “in guerra, i palestinesi cambiano telefoni in continuazione” ha dichiarato la fonte. “Le persone perdono contatto con le loro famiglie, danno il telefono ad un amico o alla moglie, lo perdono. Non c’è modo di affidarsi al 100 % ad un meccanismo automatico che determina quale numero di telefono appartiene a chi”

Sempre secondo le fonti, l’esercito sapeva che la minima supervisione umana coinvolta, non avrebbe rilevato queste falle. “non c’era una politica “zero errori”. Gli errori erano trattati statisticamente”, ha dischiarato una fonte che ha usato Lavender. “Per via del suo scopo e della grandezza, il protocollo era che anche se non eri sicuro che la macchina avesse ragione, sapevi statisticamente che andava bene. Quindi continuavi”

Si è dimostrato valido”, ha detto B., la fonte più anziana. “C’è qualcosa nell’approccio statistico che ti impone una certa norma e un certo standard. C’è stata una quantità illogica di [attentati] in questa operazione. A mia memoria, non ha precedenti. Ho molta più fiducia in un meccanismo statistico che in un soldato che ha perso un amico due giorni fa. Tutti, me compreso, hanno perso delle persone il 7 ottobre. La macchina lo ha fatto freddamente. E questo ha reso tutto più facile”.

Un’altra fonte dei servizi, che ha difeso l’affidabilità della “kill list” di palestinesi sospetti, generata da Lavender, ha sostenuto che valeva la pena investire il tempo di un ufficiale dei servizi per verificare l’informazione riguardante il fatto che un bersaglio fosse un comandante senior di Hamas. “Ma quando si tratta di un militante più giovane, non vuoi sprecare risorse umane e tempo” afferma” In guerra, non c’è tempo per incriminare ogni obiettivo. Quindi ti assumi la responsabilità del margine di errore usando l’intelligenza artificiale, rischiando danni collaterali e morti civili per errore, e ci convivi”.

B. ha detto che la ragione di questa automazione era una spinta costante a generare più obiettivi da assassinare. “In un giorno senza obiettivi [il cui rating era sufficiente per autorizzare un attacco], abbiamo attaccato a una soglia più bassa. Ci facevano costantemente pressione: ‘Portateci più obiettivi’. Ci urlavano davvero contro. Abbiamo finito di [uccidere] i nostri obiettivi molto rapidamente”.

Ha spiegato che abbassare il livello di rating di Lavender, avrebbe fatto emergere più persone come bersagli degli attacchi. “A massimo regime, il sistema è riuscito a generare 37.000 persone come potenziali bersagli umani” dichiara B. “ma il numero cambiava ogni volta, perché dipende da dove punti l’asticella per definire chi è un militante di Hamas. Ci sono state volte i cui la definizione di militante di Hamas era più ampia, e la macchina ha cominciato a portarci ogni tipo di personale di difesa civile, agenti di polizia, su cui sarebbe stato un peccato sprecare bombe. Loro aiutano il governo di Hamas, ma non mettono in pericolo i soldati.

”Una fonte che ha lavorato con il team scientifico di dati militari che ha addestrato Lavender ha dichiarato che nella macchina sono stati inseriti anche i dati raccolti dai dipendenti del Ministero della Sicurezza Interna gestito da Hamas, che lui non considera militanti.” Mi ha infastidito il fatto che, quando Lavender è stato addestrato, hanno usato il termine ‘agente di Hamas’ in modo generico, includendo nel set di dati dell’addestramento anche persone che lavoravano nella protezione civile”, ha detto.

Ha inoltre aggiunto che anche se si crede che queste persone meritino di essere uccise, programmare un sistema basato sui profili delle loro comunicazioni, ha reso più probabile che Lavender selezionasse civili per errore quando i suoi algoritmi venivano applicati alla popolazione comune. “Essendo un sistema automatizzato che non è gestito manualmente da umani, il senso di questa decisione è tragico: significa che stai includendo mole persone con un profilo civile,come potenziali obiettivi.”

“Abbiamo solo controllato che il bersaglio fosse un uomo”

L’esercito israeliano respinge categoricamente queste affermazioni. In una dichiarazione rilasciata a +972 e Local Call, il portavoce dell’IDF ha negato l’uso dell’intelligenza artificiale per incriminare gli obiettivi, affermando che si tratta solo di “strumenti ausiliari che assistono gli ufficiali nel processo di incriminazione”. La dichiarazione ha proseguito: “In ogni caso, è necessario un esame indipendente da parte di un analista [dell’intelligence], che verifichi che gli obiettivi identificati siano obiettivi legittimi per l’attacco, in conformità con le condizioni stabilite nelle direttive dell’IDF e nel diritto internazionale”.

Ciononostante, le fonti hanno affermato che l’unico protocollo di supervisione umana in atto prima del bombardamento delle abitazioni di sospetti militanti “junior” selezionati da Lavender, era di effettuare un unico controllo: assicurarsi che il bersaglio selezionato dall’IA fosse maschio. Il presupposto nell’esercito era che se l’obiettivo era una donna, la macchina aveva probabilmente commesso un errore, perché non ci sono donne tra i ranghi delle ali militari di Hamas e PIJ.

“Un essere umano doveva verificare il bersaglio solo per alcuni secondi”, dice B, spiegando che questo è diventato il protocollo dopo aver realizzato che il sistema Lavender “ci azzeccasse” la maggior parte delle volte. Inizialmente controllavamo per accertarci che la macchina non si confondesse. Ma ad un certo punto ci siamo affidati totalmente al sistema automatico, e controllavamo semplicemente che il bersaglio fosse un maschio -bastava questo. Non ci vuole molto per capire se qualcuno ha una voce maschile o femminile.

”Per condurre il controllo maschio/femmina, B. ha affermato che nella guerra in corso “investirei 20 secondi per ogni obiettivo in questa fase, e ne farei decine ogni giorno. Non avevo alcun valore aggiunto come essere umano, se non quello di essere un timbro di approvazione. Si risparmiava un sacco di tempo. Se [l’agente] si presentava nel meccanismo automatico, e io controllavo che fosse un uomo, avrei avuto il permesso di bombardarlo, previo esame dei danni collaterali”.

In pratica, le fonti hanno affermato che questo significava per i civili maschi segnalati per errore da Lavender, che non c’era nessun meccanismo di supervisione che potesse rilevare l’errore. Secondo B, un errore comune si verificava “se il target di Hamas dava il proprio telefono a suo figlio, a suo fratello maggiore o a un uomo qualsiasi. Questa persona sarebbe stata colpita nella propria casa con la propria famiglia. E’ accaduto spesso. Questi sono stati gli errori più frequenti commessi da Lavender”, ha affermato B.

STEP 2: LEGARE GLI OBIETTIVI ALLE CASE DELLE FAMIGLIE “Molte delle persone che avete ucciso erano donne e bambini”.

Il passo successivo nella procedura di assassinio dell’esercito israeliano è definire dove attaccare gli obiettivi generati da Lavender.

In una dichiarazione a +972 e Local Call, il portavoce dell’IDF ha affermato in questo articolo che “Hamas sistema i prori militanti e gli armamenti militari nel cuore della popolazione civile, usa sistematicamente i civili come scudi umani e combatte dalle strutture civili, inclusi siti sensibili come ospedali, moschee, scuole e strutture ONU. L’IDF rispetta e agisce in base al diritto internazionale, dirigendo i propri attacchi solo verso obiettivi militari e operatori militari”.

Le sei fonti con cui abbiamo parlato hanno fatto in parte eco a questa affermazione, dicendo che il vasto sistema di tunnel di Hamas passa deliberatamente sotto ospedali e scuole; che i militanti di Hamas usano le ambulanze per spostarsi; e che innumerevoli mezzi militari sono stati situati vicino a edifici civili. Le fonti hanno sostenuto che molti attacchi israeliani uccidono civili a causa di queste tattiche di Hamas – una caratterizzazione che, secondo i gruppi per i diritti umani, elude la responsabilità di Israele nel causare vittime.

Tuttavia, in contrasto con le dichiarazioni ufficiali dell’esercito israeliano, le fonti hanno spiegato che una delle ragioni principali del numero di vittime senza precedenti dell’attuale bombardamento israeliano è il fatto che l’esercito ha sistematicamente attaccato gli obiettivi nelle loro case private, insieme alle loro famiglie – in parte perché era più facile, dal punto di vista dell’intelligence, marcare le case delle famiglie usando sistemi automatizzati.

In effetti, diverse fonti hanno sottolineato che, a differenza dei numerosi casi di operatori di Hamas impegnati in attività militari da aree civili, nel caso di attacchi sistematici di assassinio, l’esercito ha scelto abitualmente di bombardare sospetti militanti all’interno di abitazioni civili da cui non si svolgeva alcuna attività militare. Questa scelta, hanno detto, è un riflesso del modo in cui è stato progettato il sistema di sorveglianza di massa di Israele a Gaza.

Le fonti hanno riferito a +972 e Local Call che, poiché ogni persona a Gaza ha una casa privata a cui può essere associata, i sistemi di sorveglianza dell’esercito possono facilmente e automaticamente “collegare” gli individui alle case di famiglia. Per identificare in tempo reale il momento in cui gli agenti entrano nelle loro case, sono stati sviluppati diversi software automatici aggiuntivi. Questi programmi tracciano migliaia di individui simultaneamente, identificano quando sono in casa e inviano un allarme automatico all’ufficiale di puntamento, che poi contrassegna la casa per il bombardamento. Uno di questi software di tracciamento, rivelato qui per la prima volta, si chiama “Where is Daddy? Dov’è papà?”.

“Si inseriscono centinaia [di obiettivi] nel sistema e si aspetta di vedere chi si riesce a uccidere”, ha detto una fonte a conoscenza del sistema. “Si chiama caccia ampia: si fa copia-incolla dalle liste che il sistema di obiettivi produce”.

La prova di questa politica è evidente anche dai dati: durante il primo mese di guerra, più della metà delle vittime – 6.120 persone – apparteneva a 1.340 famiglie, molte delle quali sono state completamente spazzate via mentre si trovavano all’interno delle loro case, secondo i dati delle Nazioni Unite. La percentuale di intere famiglie bombardate nelle loro case nell’attuale guerra è molto più alta rispetto all’operazione israeliana del 2014 a Gaza (che in precedenza era stata la guerra più letale di Israele sulla Striscia), suggerendo ulteriormente la prominenza di questa politica.

Un’altra fonte ha detto che ogni volta che il ritmo degli assassinii diminuiva, venivano aggiunti altri obiettivi a sistemi come Where’s Daddy? per individuare gli individui che entravano nelle loro case e che quindi potevano essere bombardati. Ha detto che la decisione di chi inserire nei sistemi di localizzazione poteva essere presa da ufficiali di grado relativamente basso nella gerarchia militare.

“Un giorno, di mia spontanea volontà, ho aggiunto qualcosa come 1200 nuovi obiettivi al sistema di monitoraggio, perché il numero di attacchi che erano stati effettuati, erano diminuiti” ha detto la fonte” Aveva senso secondo me. Con il senno di poi, sembra una decisione seria che ho preso. E queste decisioni non erano prese ad alti livelli”.

Le fonti hanno detto che nelle prime due settimane di guerra, “diverse migliaia” di obiettivi sono stati inizialmente inseriti in programmi di localizzazione come Dov’è papà? Tra questi c’erano tutti i membri dell’unità d’élite delle forze speciali di Hamas, la Nukhba, tutti gli operatori anticarro di Hamas e chiunque fosse entrato in Israele il 7 ottobre. Ma in breve tempo la lista degli uccisi è stata drasticamente ampliata.

“Alla fine erano tutti [segnati da Lavender]”, ha spiegato una fonte. “Decine di migliaia. Questo è successo poche settimane dopo, quando le brigate [israeliane] sono entrate a Gaza, e c’erano già meno persone non coinvolte [cioè civili] nelle aree settentrionali”. Secondo questa fonte, anche alcuni minorenni sono stati contrassegnati da Lavender come obiettivi per i bombardamenti. “Di solito gli agenti hanno più di 17 anni, ma questa non era una condizione”.

Lavender e sistemi come Where’s Daddy? sono stati quindi combinati con effetto letale, uccidendo intere famiglie, secondo le fonti. Aggiungendo un nome dagli elenchi generati da Lavender al sistema di localizzazione domestica Where’s Daddy?, ha spiegato A., la persona contrassegnata sarebbe stata posta sotto sorveglianza continua e avrebbe potuto essere attaccata non appena avesse messo piede nella propria abitazione, facendo crollare la casa su tutti i suoi abitanti.

“Diciamo che contate che ci sia un militante di Hamas più 10 civili in una casa” Dice A. “Di solito queste 10 sono donne e bambini. Quindi, per assurdo, finisce che la maggior parte di persone che uccidi sono donne e bambini.”

STEP 3: SCEGLIERE UN’ARMA

“Di solito compivamo gli attacchi con “bombe mute”

Una volta definito l’obiettivo di eliminazione da Lavander, il personale dell’esercito verificava che fossero maschi, il sistema di tracciamento localizzava nuovi bersagli nella casa e il passaggio successivo è scegliere con cosa bombardare.

Nel dicembre 2023, la CNN ha riferito che, secondo le stime dell’intelligence statunitense, circa il 45% delle munizioni utilizzate dall’aeronautica israeliana a Gaza erano bombe “stupide”, note per causare più danni collaterali rispetto alle bombe guidate. In risposta al rapporto della CNN, un portavoce dell’esercito citato nell’articolo ha detto: “Come esercito impegnato nel rispetto del diritto internazionale e di un codice morale di condotta, stiamo dedicando vaste risorse per ridurre al minimo i danni ai civili che Hamas ha costretto a ricoprire il ruolo di scudi umani. La nostra guerra è contro Hamas, non contro il popolo di Gaza”.

Tre fonti dell’intelligence, tuttavia, hanno riferito a +972 e a Local Call che gli agenti minori contrassegnati da Lavender venivano assassinati solo con bombe mute, nell’interesse di risparmiare armamenti più costosi. L’implicazione, ha spiegato una fonte, è che l’esercito non colpirebbe un bersaglio giovane se vivesse in un grattacielo, perché non vuole spendere una “bomba da pavimento” più precisa e costosa (con effetti collaterali più limitati) per ucciderlo. Ma se un obiettivo giovane viveva in un edificio di pochi piani, l’esercito era autorizzato a uccidere lui e tutti quelli che si trovavano nell’edificio con una bomba muta.

È stato così con tutti gli obiettivi junior”, ha testimoniato C., che ha utilizzato diversi programmi automatizzati nella guerra in corso. “L’unica domanda era: è possibile attaccare l’edificio in termini di danni collaterali? Perché di solito eseguivamo gli attacchi con bombe mute, e questo significava distruggere letteralmente l’intera casa sopra i suoi occupanti. Ma anche se un attacco viene evitato, non ci si preoccupa: si passa immediatamente all’obiettivo successivo. A causa del sistema, gli obiettivi non finiscono mai. Ce ne sono altri 36.000 in attesa”.

STEP 4: AUTORIZZARE VITTIME CIVILI

“Abbiamo attaccato senza considerare i danni collaterali”.

Una fonte ha riferito che quando venivano attaccati operativi minori, inclusi quelli indicati da sistemi di intelligenza artificiale come Lavender, il numero di civili che erano autorizzati ad uccidere per ogni bersaglio durante le prime settimane di guerra era fino a 20. Un’altra fonte ha dichiarato che il numero è stato fissato fino a 15. Questi “gradi di danno collaterale”, come li chiamano i militari, sono stati applicati in modo ampio a tutti i sospetti militanti minori, hanno detto le fonti, indipendentemente dal loro grado, dall’importanza militare e dall’età, e senza un esame specifico caso per caso per soppesare il vantaggio militare dell’assassinio rispetto al danno previsto per i civili.

Secondo A., che è stato ufficiale in una sala operativa durante la guerra in corso, il dipartimento di diritto internazionale dell’esercito non ha mai dato una “approvazione così ampia” per un grado di danni collaterali così elevato. “Non è solo che si può uccidere qualsiasi persona che sia un soldato di Hamas, il che è chiaramente permesso e legittimo in termini di diritto internazionale”, ha detto A. “Ma loro ti dicono direttamente: ‘Ti è permesso ucciderli insieme a molti civili’.

“Ogni persona che indossava un’uniforme di Hamas nell’ultimo anno o due poteva essere bombardata con 20 [civili uccisi come] danno collaterale, anche senza un permesso speciale”, ha continuato A.. “In pratica, il principio di proporzionalità non esisteva”.

Secondo A., questa è stata la politica per la maggior parte del tempo in cui ha prestato servizio. Solo in seguito i militari hanno abbassato il grado di danno collaterale. “In questo calcolo, potrebbero essere anche 20 bambini per un agente junior… In passato non era così”, ha spiegato A. Alla domanda sulle motivazioni di sicurezza alla base di questa politica, A. ha risposto: “Letalità”.

Il grado di danno collaterale predeterminato e fisso ha contribuito ad accelerare la creazione di massa di obiettivi utilizzando la macchina Lavender, hanno detto le fonti, perché ha fatto risparmiare tempo. B. ha affermato che il numero di civili che potevano uccidere nella prima settimana di guerra per ogni sospetto militante giovane marcato dall’IA era di quindici, ma che questo numero “è andato su e giù” nel tempo.

“All’inizio abbiamo attaccato quasi senza considerare i danni collaterali”, ha detto B. della prima settimana dopo il 7 ottobre. “In pratica, non si contavano le persone [in ogni casa bombardata], perché non si riusciva a capire se fossero in casa o meno”. Dopo una settimana sono iniziate le restrizioni sui danni collaterali. Il numero è sceso [da 15] a cinque, il che ha reso molto difficile per noi attaccare, perché se l’intera famiglia era in casa, non potevamo bombardarla. Poi hanno alzato di nuovo il numero”.

“Sapevamo che avremmo ucciso più di 100 civili “

Le fonti hanno riferito a +972 e Local Call che ora, in parte a causa delle pressioni americane, l’esercito israeliano non sta più generando in massa obiettivi umani junior da bombardare nelle case dei civili. Il fatto che la maggior parte delle case nella Striscia di Gaza fossero già distrutte o danneggiate, e che quasi tutta la popolazione fosse sfollata, ha compromesso la capacità dell’esercito di affidarsi a database di intelligence e a programmi automatici di localizzazione delle case.

E ha affermato che il bombardamento massiccio dei militanti junior è avvenuto solo nella prima o due settimane di guerra, e poi è stato interrotto soprattutto per non sprecare bombe. “C’è un’economia delle munizioni”, ha detto E.”Hanno sempre avuto paura che ci fosse [una guerra] nell’area settentrionale [con Hezbollah in Libano]. Non attaccano più questo tipo di persone [junior]”.

Tuttavia, gli attacchi aerei contro i comandanti di alto livello di Hamas sono ancora in corso e le fonti hanno detto che per questi attacchi, l’esercito sta autorizzando l’uccisione di “centinaia” di civili per obiettivo – una politica ufficiale per la quale non ci sono precedenti storici in Israele, o anche nelle recenti operazioni militari statunitensi.

“Nel bombardamento del comandante del Battaglione Shuja’iya, sapevamo che avremmo ucciso più di 100 civili”, ha ricordato B. a proposito del bombardamento del 2 dicembre che, secondo il portavoce dell’IDF, mirava ad assassinare Wisam Farhat. “Per me, psicologicamente, è stato insolito. Più di 100 civili – questo supera una certa linea rossa”.

Amjad Al-Sheikh, un giovane palestinese di Gaza, ha raccontato che molti membri della sua famiglia sono stati uccisi in quel bombardamento. Residente a Shuja’iya, a est di Gaza City, quel giorno si trovava in un supermercato locale quando ha sentito cinque esplosioni che hanno mandato in frantumi le vetrate.

“Sono corso a casa della mia famiglia, ma non c’erano più edifici”, ha raccontato Al-Sheikh a +972 e Local Call. “La strada era piena di urla e fumo. Interi isolati residenziali si sono trasformati in montagne di macerie e fosse profonde. La gente ha iniziato a cercare nel cemento, usando le mani, e anch’io ho cercato segni della casa della mia famiglia”.

La moglie e la figlioletta di Al-Sheikh sono sopravvissute – protette dalle macerie da un armadio caduto sopra di loro – ma ha trovato altri 11 membri della sua famiglia, tra cui le sorelle, i fratelli e i loro figli piccoli, morti sotto le macerie. Secondo il gruppo per i diritti umani B’Tselem, quel giorno il bombardamento ha distrutto decine di edifici, ucciso decine di persone e sepolto centinaia di persone sotto le rovine delle loro case.

“Intere famiglie sono state uccise”

Fonti dell’intelligence hanno dichiarato a +972 e Local Call di aver preso parte ad attacchi ancora più letali. Per assassinare Ayman Nofal, il comandante della Brigata Centrale di Gaza di Hamas, una fonte ha detto che l’esercito ha autorizzato l’uccisione di circa 300 civili, distruggendo diversi edifici in attacchi aerei sul campo profughi di Al-Bureij il 17 ottobre, sulla base di una localizzazione imprecisa di Nofal. Le immagini satellitari e i video della scena mostrano la distruzione di diversi grandi edifici di appartamenti a più piani.

Nell’attacco sono state spazzate via dalle 16 alle 18 case”, ha dichiarato Amro Al-Khatib, un residente del campo, a +972 e Local Call. “Non riuscivamo a distinguere un appartamento dall’altro, erano tutti confusi tra le macerie e abbiamo trovato parti di corpi umani ovunque”.

In seguito, Al-Khatib ha ricordato che sono stati estratti dalle macerie circa 50 cadaveri e circa 200 feriti, molti dei quali gravi. Ma questo era solo il primo giorno. I residenti del campo hanno trascorso cinque giorni a tirare fuori i morti e i feriti, ha detto.

Nael Al-Bahisi, un paramedico, è stato uno dei primi ad arrivare sul posto. Ha contato tra le 50-70 vittime in quel primo giorno. “A un certo punto abbiamo capito che l’obiettivo dell’attacco era il comandante di Hamas Ayman Nofal”, ha detto a +972 e Local Call. “Hanno ucciso lui e anche molte persone che non sapevano che fosse lì. Sono state uccise intere famiglie con bambini”.

Un’altra fonte dell’intelligence ha dichiarato a +972 e Local Call che l’esercito ha distrutto un grattacielo a Rafah a metà dicembre, uccidendo “decine di civili”, per cercare di uccidere Mohammed Shabaneh, il comandante della Brigata Rafah di Hamas (non è chiaro se sia stato ucciso o meno nell’attacco). Spesso, ha detto la fonte, gli alti comandanti si nascondono in tunnel che passano sotto edifici civili, e quindi la scelta di assassinarli con un attacco aereo uccide necessariamente dei civili.

“La maggior parte dei feriti erano bambini”, ha detto Wael Al-Sir, 55 anni, che ha assistito all’attacco su larga scala che alcuni gazawi ritengono sia stato un attentato. Ha dichiarato a +972 e Local Call che il bombardamento del 20 dicembre ha distrutto “un intero isolato residenziale” e ucciso almeno 10 bambini.

“C’era una politica completamente permissiva riguardo alle vittime delle operazioni [di bombardamento] – così permissiva che a mio parere aveva un elemento di vendetta”, ha affermato D., una fonte dell’intelligence. “Il fulcro di questa politica era l’assassinio di alti comandanti [di Hamas e PIJ] per i quali erano disposti a uccidere centinaia di civili. Avevamo un calcolo: quanti per un comandante di brigata, quanti per un comandante di battaglione e così via”.

“C’erano dei regolamenti, ma erano molto indulgenti”, ha detto E., un’altra fonte dell’intelligence. “Abbiamo ucciso persone con danni collaterali a due cifre, se non a tre cifre. Sono cose che non erano mai successe prima”.

Un tasso così elevato di “danni collaterali” è eccezionale non solo rispetto a ciò che l’esercito israeliano considerava accettabile in precedenza, ma anche rispetto alle guerre condotte dagli Stati Uniti in Iraq, Siria e Afghanistan.

Il generale Peter Gersten, vicecomandante per le operazioni e l’intelligence nell’operazione di lotta all’ISIS in Iraq e Siria, ha dichiarato a una rivista di difesa statunitense nel 2021 che un attacco con danni collaterali di 15 civili si discostava dalla procedura; per portarlo a termine, ha dovuto ottenere un permesso speciale dal capo del Comando centrale degli Stati Uniti, il generale Lloyd Austin, che ora è segretario alla Difesa.

“Con Osama Bin Laden, si aveva un NCV (Non-combatant Casualty Value) di 30, ma se si aveva un comandante di basso livello, il suo NCV era tipicamente zero”, ha detto Gersten. “Per molto tempo abbiamo avuto un valore pari a zero”.

“Ci è stato detto:”Bombardate tutto ciò che potete”

Tutte le fonti intervistate per questa indagine hanno affermato che i massacri di Hamas del 7 ottobre e il rapimento degli ostaggi hanno influenzato notevolmente la politica di fuoco dell’esercito e i gradi di danno collaterale. “All’inizio l’atmosfera era dolorosa e vendicativa”, ha detto B., che è stato arruolato nell’esercito subito dopo il 7 ottobre e ha prestato servizio in una sala operativa. “Le regole erano molto indulgenti. Hanno abbattuto quattro edifici quando sapevano che l’obiettivo era in uno di essi. Era una follia.

“C’era una dissonanza: da un lato, la gente qui era frustrata perché non stavamo attaccando abbastanza”, ha continuato B.. “Dall’altro, alla fine della giornata si vede che sono morti altri mille gazawi, la maggior parte dei quali erano civili”.

“C’era isteria nei ranghi professionali”, ha detto D., anche lui arruolato subito dopo il 7 ottobre. “Non avevano la minima idea di come reagire. L’unica cosa che sapevano fare era iniziare a bombardare come pazzi per cercare di smantellare le capacità di Hamas”.

D. ha sottolineato che non gli è stato detto esplicitamente che l’obiettivo dell’esercito è la “vendetta”, ma ha espresso che “non appena ogni obiettivo collegato ad Hamas diventa legittimo, e con l’approvazione di quasi tutti i danni collaterali, è chiaro che migliaia di persone saranno uccise”. Anche se ufficialmente ogni obiettivo è collegato ad Hamas, quando la politica è così permissiva, perde ogni significato”.

A. ha anche usato la parola “vendetta” per descrivere l’atmosfera all’interno dell’esercito dopo il 7 ottobre. “Nessuno ha pensato a cosa fare dopo, quando la guerra sarà finita, o a come sarà possibile vivere a Gaza e cosa ne faranno”, ha detto A.. “Ci è stato detto: ora dobbiamo distruggere Hamas, a qualunque costo. Tutto ciò che si può, si bombarda”.

B.,fonte senior dell’intelligence, ha detto che, a posteriori, ritiene che questa politica “sproporzionata” di uccisione dei palestinesi a Gaza metta in pericolo anche gli israeliani, e che questo è stato uno dei motivi per cui ha deciso di farsi intervistare.

“Nel breve termine, siamo più sicuri, perché abbiamo danneggiato Hamas. Ma credo che a lungo termine siamo meno sicuri. Vedo come tutte le famiglie in lutto a Gaza – che sono quasi tutti – aumenteranno la motivazione per [le persone a unirsi a] Hamas 10 anni dopo. E sarà molto più facile per [Hamas] reclutarli”.

In una dichiarazione rilasciata a +972 e Local Call, l’esercito israeliano ha smentito gran parte di ciò che le fonti ci hanno riferito, sostenendo che “ogni obiettivo viene esaminato individualmente, mentre viene fatta una valutazione individuale del vantaggio militare e dei danni collaterali attesi dall’attacco… L’IDF non esegue attacchi quando i danni collaterali attesi dall’attacco sono eccessivi rispetto al vantaggio militare”.

STEP 5: CALCOLO DEI DANNI COLLATERALI

“Il modello non era collegato alla realtà”

Secondo le fonti di intelligence, il calcolo da parte dell’esercito israeliano del numero di civili che si prevedeva venissero uccisi in ogni casa accanto a un obiettivo – una procedura esaminata in una precedente indagine di +972 e Local Call – è stato condotto con l’aiuto di strumenti automatici e imprecisi. Nelle guerre precedenti, il personale dell’intelligence dedicava molto tempo a verificare quante persone si trovassero in una casa destinata a essere bombardata, e il numero di civili suscettibili di essere uccisi veniva elencato come parte di un “dossier obiettivo”. Dopo il 7 ottobre, tuttavia, questa verifica approfondita è stata ampiamente abbandonata a favore dell’automazione.

A ottobre, il New York Times ha riferito di un sistema gestito da una base speciale nel sud di Israele, che raccoglie informazioni dai telefoni cellulari nella Striscia di Gaza e fornisce ai militari una stima in tempo reale del numero di palestinesi fuggiti dal nord della Striscia di Gaza verso sud. Il generale di brigata Udi Ben Muha ha dichiarato al Times che “non è un sistema perfetto al 100% – ma fornisce le informazioni necessarie per prendere una decisione”. Il sistema funziona in base ai colori: il rosso indica le aree in cui ci sono molte persone, mentre il verde e il giallo indicano le aree che sono state relativamente liberate dai residenti.

Le fonti che hanno parlato con +972 e Local Call hanno descritto un sistema simile per il calcolo dei danni collaterali, utilizzato per decidere se bombardare un edificio a Gaza. Hanno detto che il software calcolava il numero di civili che risiedevano in ogni casa prima della guerra – valutando le dimensioni dell’edificio e rivedendo la lista dei residenti – e poi riduceva questi numeri per la percentuale di residenti che presumibilmente avevano evacuato il quartiere.

Per esempio, se l’esercito stimava che la metà dei residenti di un quartiere se ne fosse andata, il programma contava una casa che di solito aveva 10 residenti come una casa con cinque persone. Per risparmiare tempo, hanno detto le fonti, l’esercito non ha sorvegliato le case per verificare quante persone vi abitassero effettivamente, come aveva fatto in precedenti operazioni, per scoprire se la stima del programma fosse effettivamente accurata.

“Questo modello non era collegato alla realtà”, ha affermato una fonte. “Non c’era alcun collegamento tra coloro che si trovavano nella casa ora, durante la guerra, e coloro che erano indicati come abitanti della casa prima della guerra. In un’occasione abbiamo bombardato una casa senza sapere che all’interno c’erano diverse famiglie, nascoste insieme”.

La fonte ha detto che, sebbene l’esercito sapesse che tali errori potevano verificarsi, questo modello impreciso è stato comunque adottato, perché era più veloce. Per questo motivo, ha detto la fonte, “il calcolo dei danni collaterali era completamente automatico e statistico” – producendo anche cifre che non erano intere.

STEP 6: BOMBARDARE LA CASA DI UNA FAMIGLIA

Avete ucciso una famiglia senza motivo

Le fonti che hanno parlato con +972 e Local Call hanno spiegato che a volte c’era un notevole divario tra il momento in cui i sistemi di localizzazione come Where’s Daddy? avvisavano un ufficiale che un bersaglio era entrato in casa loro, e il bombardamento stesso – portando all’uccisione di intere famiglie anche senza colpire l’obiettivo dell’esercito. “Mi è capitato molte volte di attaccare una casa, ma la persona non era nemmeno in casa”, ha detto una fonte. “Il risultato è che è stata uccisa una famiglia senza motivo”.

Tre fonti dell’intelligence hanno riferito a +972 e Local Call di aver assistito a un incidente in cui l’esercito israeliano ha bombardato la casa privata di una famiglia, e in seguito si è scoperto che l’obiettivo presunto dell’assassinio non era nemmeno all’interno della casa, poiché non erano state effettuate ulteriori verifiche.

“A volte [l’obiettivo] era a casa prima, e poi la sera è andato a dormire da qualche altra parte, per esempio sottoterra, e non lo sapevi”, ha detto una delle fonti. Ci sono volte in cui si ricontrolla la posizione e altre in cui si dice semplicemente: “Ok, era in casa nelle ultime ore, quindi puoi bombardare””.

Un’altra fonte ha descritto un episodio simile che lo ha colpito e che lo ha spinto a farsi intervistare per questa indagine. “Abbiamo capito che l’obiettivo era a casa alle 20. Alla fine l’aviazione ha bombardato la casa alle 3. Poi abbiamo scoperto che [in quel lasso di tempo] era riuscito a trasferirsi in un’altra casa con la sua famiglia. Nell’edificio che abbiamo bombardato c’erano altre due famiglie con bambini”.

Nelle guerre precedenti a Gaza, dopo l’uccisione di obiettivi umani, l’intelligence israeliana eseguiva procedure di valutazione dei danni da bomba (BDA) – un controllo di routine dopo l’attacco per verificare se il comandante senior fosse stato ucciso e quanti civili fossero stati uccisi insieme a lui. Come rivelato in una precedente indagine di +972 e Local Call, ciò comportava l’ascolto delle telefonate dei parenti che avevano perso i loro cari. Nella guerra attuale, tuttavia, almeno per quanto riguarda i militanti più giovani marcati con l’AI, le fonti affermano che questa procedura è stata abolita per risparmiare tempo. Le fonti hanno affermato di non sapere quanti civili siano stati effettivamente uccisi in ogni attacco e, per i sospetti militanti di Hamas e PIJ di basso rango contrassegnati dall’IA, non sanno nemmeno se il bersaglio stesso sia stato ucciso.

“Non si sa esattamente quanti ne avete uccisi e chi avete ucciso”, ha detto una fonte dell’intelligence a Local Call per una precedente inchiesta pubblicata a gennaio. “Solo quando si tratta di alti funzionari di Hamas si segue la procedura del BDA. Nel resto dei casi, non ci si preoccupa. Si riceve un rapporto dall’aeronautica sul fatto che l’edificio sia stato fatto saltare in aria, e questo è tutto. Non si ha idea di quanti danni collaterali ci siano stati; si passa immediatamente all’obiettivo successivo. L’enfasi era di creare il maggior numero possibile di obiettivi, il più rapidamente possibile”.

Ma mentre l’esercito israeliano può andare avanti con ogni attacco senza soffermarsi sul numero di vittime, Amjad Al-Sheikh, il residente di Shuja’iya che ha perso 11 membri della sua famiglia nel bombardamento del 2 dicembre, ha detto che lui e i suoi vicini stanno ancora cercando i cadaveri.

“Fino ad ora ci sono corpi sotto le macerie”, ha detto. “Quattordici edifici residenziali sono stati bombardati con i loro residenti all’interno. Alcuni dei miei parenti e vicini sono ancora sepolti”.

Traduzione di Mavi Morano -Invictapalestina.org